機器學習的七個步驟

機器學習的流程共有以下七個步驟:

- 收集資料(Gathering data )

- 準備數據(Preparing that data)

- 選擇模型(Choosing a model)

- 訓練機器(Training)

- 評估分析(Evaluation)

- 調整參數(Hyperparameter tuning)

- 預測推論(Prediction)

分類器 Classifcation

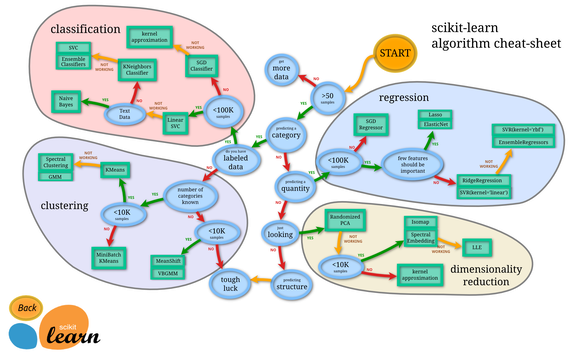

由上圖所示:機器學習分為四大塊: classification (分類), clustering (聚類), regression (回歸), dimensionality reduction (降維)。

(1)(2)classification & regression

給定一個樣本特徵 x, 我們希望預測其對應的屬性值 y, 如果 y 是離散的, 那麼這就是一個分類問題,

反之,如果 y 是連續的實數, 這就是一個回歸問題。

(3)clustering (聚類)

聚類也是分析樣本的屬性, 有點類似classification, 不同的就是classification 在預測之前是知道 y 的範圍, 或者說知道到底有幾個類別, 而聚類是不知道屬性的範圍的。所以 classification 也常常被稱為 supervised learning, 而clustering就被稱為 unsupervised learning。

(4)dimensionality reduction

降維是機器學習另一個重要的領域, 降維有很多重要的應用, 特徵的維數過高, 會增加訓練的負擔與存儲空間, 降維就是希望去除特徵的冗餘, 用更加少的維數來表示特徵. 降維算法最基礎的就是PCA了,

機器學習常見算法

機器學習領域涉及到很多的算法和模型,這裡遴選一些常見的算法:

-

正則化算法(Regularization Algorithms)

-

集成算法(Ensemble Algorithms)

-

決策樹算法(Decision Tree Algorithm)

-

回歸(Regression)

-

人工神經網絡(Artificial Neural Network)

-

深度學習(Deep Learning)

-

支持向量機(Support Vector Machine)

-

降維算法(Dimensionality Reduction Algorithms)

-

聚類算法(Clustering Algorithms)

-

基於實例的算法(Instance-based Algorithms)

-

貝葉斯算法(Bayesian Algorithms)

-

關聯規則學習算法(Association Rule Learning Algorithms)

-

圖模型(Graphical Models) ### 正則化算法(Regularization Algorithms) 正則化算法是另一種方法(通常是回歸方法)的拓展,這種方法會基於模型複雜性對其進行懲罰,它喜歡相對簡單能夠更好的泛化的模型。 正則化中我們將保留所有的特徵變量,但是會減小特徵變量的數量級(參數數值的大小θ(j))。這個方法非常有效,當我們有很多特徵變量時,其中每一個變量都能對預測產生一點影響。 算法實例:

-

嶺回歸(Ridge Regression)

-

最小絕對收縮與選擇算子(LASSO)

-

GLASSO

-

彈性網絡(Elastic Net)

-

最小角回歸(Least-Angle Regression)

原文網址:https://kknews.cc/news/4qmlrzg.html

原文網址:https://kknews.cc/news/4qmlrzg.html

原文網址:https://kknews.cc/news/4qmlrzg.html

參考資料:https://kknews.cc/news/4qmlrzg.html

留言列表

留言列表